Il mondo nuovo e coraggioso dell’occupazione sotto l’intelligenza artificiale… E che dire delle forze compensative?

Ho dato un’occhiata a un nuovo documento del FMI sull’impatto previsto sull’economia, e in particolare sul mercato del lavoro, dell’incorporazione dell’intelligenza artificiale nelle operazioni commerciali e governative . Come ampiamente riportato dalla stampa economica, il Fondo monetario internazionale prevede che il 60% dei posti di lavoro nelle economie avanzate potrebbe essere “influenzato” dall’intelligenza artificiale, con la stima approssimativa che la metà vedrebbe incrementi di produttività e l’altra metà vedrebbe l’intelligenza artificiale sostituire il loro lavoro in parte o in totale, con conseguente perdita di posti di lavoro. Non capisco perché questo risultato non dovrebbe essere vero anche per i ruoli che prevedono un miglioramento della produttività, dal momento che più produttività => più output dei lavoratori => non tanti lavoratori necessari.

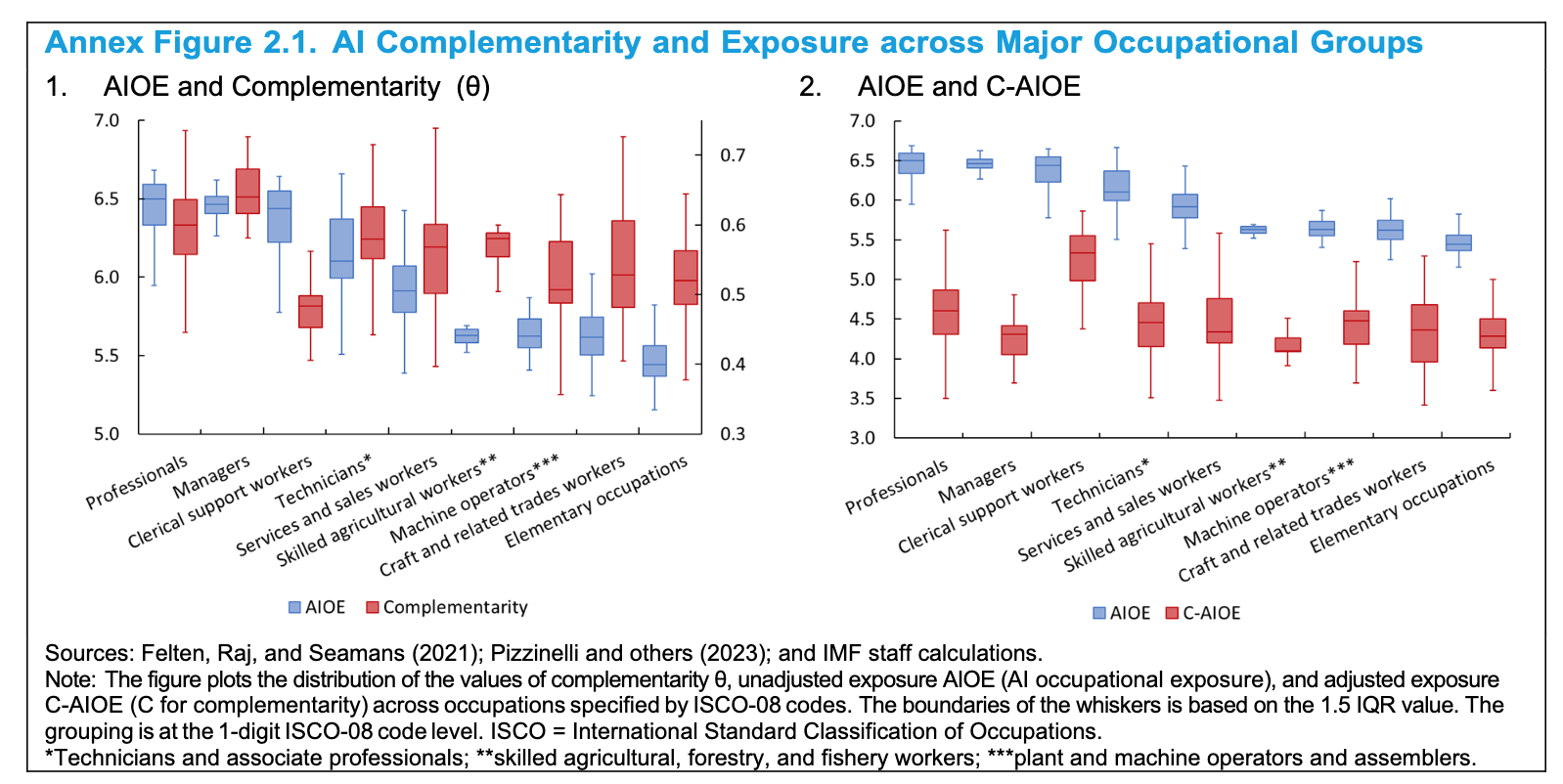

In ogni caso, questo articolo del FMI non è innovativo, in linea con il fatto che sembra essere una revisione della letteratura esistente più alcune analisi basate su documenti chiave. Si noti inoltre che le categorie lavorative hanno un livello di astrazione piuttosto elevato:

Intendiamoci, non sto contestando le previsioni del FMI. Potrebbe benissimo rivelarsi estremamente accurato.

Ciò che mi tormenta in questo articolo, e in molte altre discussioni sul futuro dell’intelligenza artificiale, è l’incapacità di prendere in adeguata considerazione alcuni degli ostacoli all’adozione. Iniziamo con:

Difficoltà nel creare set di formazione sufficientemente robusti. Ricordate i camion e le auto a guida autonoma? Questa tecnologia era stata pubblicizzata come destinata ad essere già ampiamente adottata, almeno nei veicoli in ride-sharing. Se ciò fosse accaduto, avrebbe avuto un grande impatto sull’occupazione. Guidare un camion o un taxi è una grande fonte di lavoro per i meno istruiti, in particolare per gli uomini (e in particolare per gli ex detenuti che hanno grandi difficoltà a trovare lavori regolarmente retribuiti). Secondo altLine, citando il Bureau of Labor Statistics, la guida di camion era la principale categoria di lavoro a tempo pieno per gli uomini, rappresentando il 4% del totale nel 2020. Nel 2022, American Trucking ha stimato il numero totale di camionisti (comprese le donne) a 3,5 milioni. Per riferimento, Data USA stima il numero totale di tassisti nel 2021 a 284.000 , più 1,7 milioni di conducenti di rideshare negli Stati Uniti, sebbene non siano tutti a tempo pieno.

Un articolo del Guardian di dicembre spiegava perché le auto senza conducente sono ora “ sulla strada che porta al nulla ”. Vale la pena leggere l’intero articolo, con questa sezione chiave:

Le aziende tecnologiche hanno costantemente sottovalutato l’enorme difficoltà di eguagliare, per non parlare di migliorare, le capacità di guida umane. È qui che la tecnologia non è riuscita a fornire risultati. L’intelligenza artificiale è un nome di fantasia per il molto meno sexy “apprendimento automatico” e implica “insegnare” al computer a interpretare ciò che sta accadendo nell’ambiente stradale molto complesso. Il problema è che esiste un numero enorme di potenziali casi d’uso, che vanno dall’esempio molto utilizzato di un cammello che vaga lungo Main Street a un semplice sasso sulla strada, che può o meno essere semplicemente un sacchetto di carta. Gli esseri umani sono eccezionalmente bravi nel valutare istantaneamente questi rischi, ma se un computer non è stato informato dei cammelli non saprà come rispondere. Secondo l’analisi successiva, sono stati i sacchetti di plastica appesi sulla bicicletta di [il pedone Elaine] Herzberg a confondere il computer dell’auto per sei secondi fatali.

Un modo semplice di pensare al problema è che le situazioni che l’intelligenza artificiale deve affrontare sono troppo ampie e divergenti per creare set di formazione adeguati da remoto.

Responsabilità. La responsabilità per i danni arrecati da un algoritmo è un altro ostacolo all’adozione. Se leggi la storia del Guardian sulle auto a guida autonoma, vedrai che sia Uber che GM hanno fatto marcia indietro dopo gli incidenti. Almeno non sono entrati in modalità Ford Pinto, ritenendo accettabile un certo livello di morte e deturpazione visti i potenziali profitti.

C’è da chiedersi se gli assicuratori sanitari riterranno accettabile l’uso dell’intelligenza artificiale nella pratica medica. Se, ad esempio, un algoritmo fornisce un falso negativo su uno schermo diagnostico per il cancro (ad esempio un’immagine), chi è responsabile? Dubito che gli assicuratori permetteranno che medici o ospedali provino a incolpare Microsoft o chiunque sia il fornitore di intelligenza artificiale (e sono sicuri di avere clausole che limitano severamente la loro esposizione). Inoltre, sarebbe probabilmente una violazione della responsabilità professionale affidare il giudizio a un algoritmo. Inoltre, il medico dovrebbe desiderare che qualsiasi fornitore di intelligenza artificiale abbia versato una cauzione o abbia comunque un peso finanziario dimostrabile sufficiente per assorbire eventuali danni.

Posso facilmente vedere non solo gli assicuratori sanitari limitare l’uso dell’intelligenza artificiale (non vogliono dover inseguire più parti per il pagamento in caso di negligenza o Shit Happens di quanto non facciano ora) ma anche gli assicuratori di responsabilità professionale, come scrittore di negligenza medica e polizze di responsabilità professionale per gli avvocati.

Utilizzo dell’energia. È probabile che il costo energetico dell’intelligenza artificiale si traduca in limitazioni al suo utilizzo, tramite tasse sugli utenti finali, tasse sui costi complessivi di calcolo o l’impatto dei prezzi più elevati dell’energia. Da Scientific American lo scorso ottobre:

Negli ultimi mesi i ricercatori hanno lanciato allarmi generali sull’elevato fabbisogno energetico dell’intelligenza artificiale. Ma un’analisi peer-reviewed pubblicata questa settimana su Joule è una delle prime a quantificare la domanda che si sta rapidamente materializzando. Il proseguimento delle attuali tendenze in termini di capacità e adozione dell’intelligenza artificiale porterà NVIDIA a spedire 1,5 milioni di unità server AI all’anno entro il 2027. Questi 1,5 milioni di server, funzionanti a piena capacità, consumerebbero almeno 85,4 terawattora di elettricità all’anno, più di quello che molti piccoli paesi consumano in un anno, secondo la nuova valutazione.

Intendiamoci, questo sarà solo entro il 2027. E considera che anche i costi energetici riflettono una maggiore installazione di hardware. Sempre dallo stesso articolo, citando il data scientist Alex de Vries, che ha elaborato la stima del consumo energetico per il 2027:

Ho inserito un esempio di ciò nel mio articolo di ricerca: ho sottolineato che se trasformassi completamente il motore di ricerca di Google in qualcosa come ChatGPT e tutti lo usassero in questo modo, avresti nove miliardi di interazioni chatbot invece di nove miliardi di ricerche regolari per giorno, quindi il consumo di energia di Google aumenterebbe. Google avrebbe bisogno della stessa potenza dell’Irlanda solo per far funzionare il suo motore di ricerca.

Ora, questo non accadrà perché anche Google dovrebbe investire 100 miliardi di dollari in hardware per renderlo possibile. E anche se [l’azienda] avesse i soldi da investire, la catena di fornitura non potrebbe consegnare subito tutti quei server. Ma penso ancora che sia utile illustrare che se si intende utilizzare l’intelligenza artificiale generativa in applicazioni [come un motore di ricerca], ciò ha il potenziale per rendere ogni interazione online molto più pesante in termini di risorse.

Sabotaggio. Nonostante il FMI cerchi di dare una faccia felice alla rivoluzione dell’intelligenza artificiale (che alcuni diventeranno più produttivi, il che potrebbe significare retribuzioni migliori), la realtà è che le persone odiano il cambiamento, in particolare l’incertezza sui ruoli lavorativi e sulla sopravvivenza professionale. Il documento del Fondo monetario internazionale menzionava casualmente gli operatori di telemarketing come una categoria lavorativa pronta per essere sostituita dall’intelligenza artificiale. Non è difficile immaginare coloro che si risentono per la sostituzione di persone spesso irritanti con test algoritmici almeno altrettanto irriganti per trovare modi per gettare l’intelligenza artificiale nelle allucinazioni e, se ci riescono, condividere l’approccio. O in alternativa, trovare modi per legarlo, ad esempio con registrazioni che potrebbero tenerlo impegnato per ore (poiché presumibilmente richiederebbe più lavoro con i set di addestramento per insegnare all’IA quando terminare un’interazione deliberatamente dispendiosa in termini di tempo).

Un’altra area di potenziali ritorni di fiamma nell’uso dell’intelligenza artificiale nella sicurezza, in particolare legata alle transazioni finanziarie. Ancora una volta, il sabotatore potrebbe non aver bisogno di avere tanto successo quanto rompere gli strumenti per rubare denaro. Potrebbero invece, come in una versione più sofisticata della “vendetta dei telemarketing”, cercare di bloccare il servizio clienti o i processi di convalida della sicurezza. Mezza giornata senza accesso ai clienti sarebbe molto dannosa per un grande istituto.

Quindi non sarei così sicuro che l’implementazione dell’intelligenza artificiale sarà così rapida e ampia come descritto dagli appassionati. Rimani sintonizzato.

Fonte: nakedCapitalism

https://www.asterios.it/catalogo/ia-intelligenza-artificiale

https://www.asterios.it/catalogo/ia-intelligenza-artificiale